L’IA n’est plus un sujet technologique, mais un sujet ESG

L’intelligence artificielle s’impose aujourd’hui comme une infrastructure invisible mais omniprésente dans les organisations les plus performantes. Elle optimise des chaînes logistiques, automatise des décisions, génère du contenu, anticipe des comportements. En parallèle, les exigences liées à l’ESG — environnement, social et gouvernance — se renforcent, portées par les régulations, les investisseurs et une attente sociétale croissante.

Ces deux dynamiques ne sont plus indépendantes. Elles convergent.

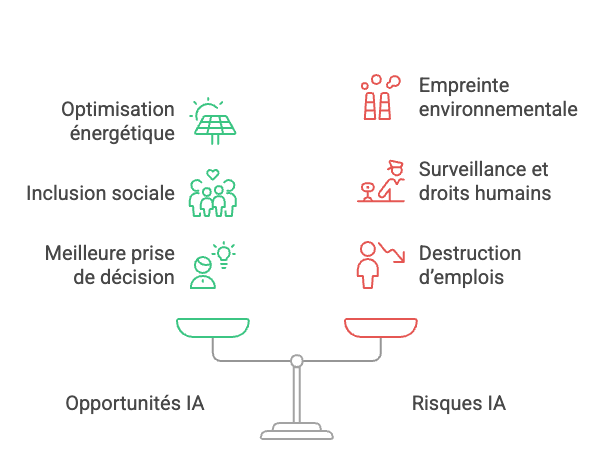

Ce qui relevait encore récemment d’un sujet technique, piloté par les équipes IT ou innovation, devient désormais un enjeu transversal. L’IA influence directement la performance environnementale (via sa consommation de ressources ou son potentiel d’optimisation), les impacts sociaux (emploi, inclusion, biais) et les pratiques de gouvernance (transparence, responsabilité, auditabilité).

Autrement dit, l’IA redéfinit les contours mêmes de la performance durable.

Pourtant, dans de nombreuses organisations, cette transformation est encore sous-estimée. L’IA est souvent abordée sous l’angle de la productivité ou de la compétitivité, rarement comme un objet de gouvernance ESG à part entière. Cette approche fragmentée crée un angle mort stratégique : elle empêche d’anticiper les risques systémiques tout en limitant la capacité à capter pleinement les opportunités.

Car l’enjeu n’est pas simplement d’adopter l’IA, mais de comprendre ce qu’elle change en profondeur. Par son échelle, sa vitesse et sa capacité à transformer des systèmes entiers, l’IA agit comme un multiplicateur — à la fois des impacts positifs et des externalités négatives.

Dans ce contexte, une question s’impose progressivement :

comment intégrer l’intelligence artificielle dans une logique de performance durable, sans en subir les dérives ?

C’est précisément là que l’ESG retrouve un rôle central. Non pas comme un cadre de conformité supplémentaire, mais comme une grille de lecture structurante pour piloter l’IA de manière responsable, mesurable et stratégique.

L’enjeu dépasse donc la technologie. Il s’agit désormais de gouvernance.

Comprendre l’IA dans une logique ESG

Avant d’analyser ses impacts, encore faut-il clarifier ce que recouvre réellement l’intelligence artificielle dans un contexte opérationnel. L’IA n’est pas une technologie unique, mais un ensemble de systèmes capables d’exploiter des données pour produire des prédictions, des recommandations ou des décisions. Dans la pratique, la majorité des usages actuels repose sur des IA dites “spécialisées”, conçues pour des tâches précises : optimiser une chaîne logistique, détecter une fraude, recommander un produit.

À côté de ces systèmes, les IA génératives — désormais largement médiatisées — introduisent une capacité nouvelle : produire du contenu (texte, image, code) à grande échelle. Cette évolution élargit considérablement le périmètre d’impact de l’IA, en la faisant passer d’un outil d’optimisation à un outil de transformation des activités.

Mais c’est moins la nature de l’IA que ses propriétés qui intéressent l’ESG. Trois caractéristiques structurantes se dégagent :

- la vitesse d’exécution,

- la capacité à traiter des volumes massifs de données,

- et la faculté à automatiser des décisions complexes.

Ces éléments changent d’échelle les enjeux déjà présents dans les démarches de durabilité.

L’IA ne crée pas ex nihilo de nouveaux sujets ESG. Elle agit plutôt comme un amplificateur. Un biais existant dans un processus de recrutement, par exemple, peut être reproduit et diffusé à grande échelle par un algorithme. À l’inverse, une bonne pratique — comme l’optimisation énergétique — peut être déployée de manière beaucoup plus efficace grâce à ces mêmes technologies.

Cette logique d’amplification est centrale. Elle implique que l’IA ne peut pas être traitée indépendamment des enjeux ESG existants. Elle s’inscrit dans des systèmes déjà complexes — économiques, sociaux, environnementaux — qu’elle vient accélérer, renforcer ou parfois déséquilibrer.

Dans cette perspective, intégrer l’IA dans une stratégie ESG revient moins à ajouter une nouvelle brique qu’à revisiter l’ensemble du modèle de pilotage. Les questions évoluent :

- comment s’assurer que les données utilisées sont représentatives et non biaisées ?

- comment mesurer l’empreinte environnementale d’un modèle ?

- comment garantir la transparence d’une décision automatisée ?

Ces interrogations traduisent un déplacement du sujet.

L’IA n’est plus seulement un levier d’innovation, mais un facteur structurant de risque et de performance durable.

L’IA comme accélérateur de performance ESG

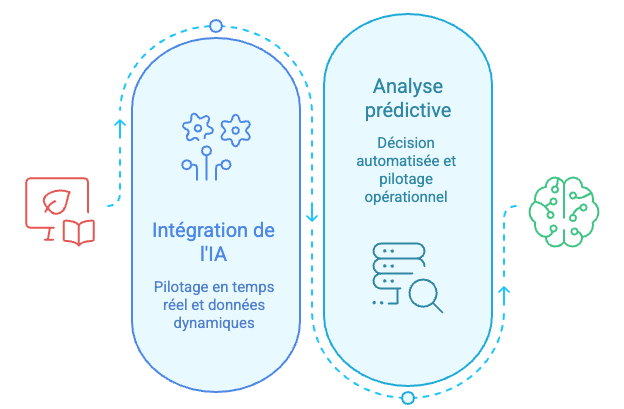

L’un des apports les plus tangibles de l’intelligence artificielle réside dans sa capacité à transformer l’ESG d’un exercice souvent déclaratif en un levier opérationnel. Là où les démarches traditionnelles reposent encore largement sur du reporting a posteriori, l’IA permet d’entrer dans une logique de pilotage en temps réel, fondée sur la donnée.

Sur le plan environnemental, les gains potentiels sont déjà visibles. L’IA permet d’optimiser la consommation énergétique, d’anticiper les besoins en ressources ou encore de modéliser des scénarios complexes. Les systèmes de type “digital twin”(Jumeaux Numériques en Français), par exemple, offrent la possibilité de simuler des infrastructures ou des processus industriels afin d’en améliorer l’efficacité sans intervention physique. De même, les réseaux énergétiques deviennent plus intelligents grâce à des algorithmes capables d’équilibrer l’offre et la demande en continu. Ces usages traduisent un basculement : l’environnement n’est plus seulement mesuré, il est piloté.

Sur le volet social, les impacts sont plus ambivalents mais tout aussi structurants. L’IA peut améliorer significativement l’accès aux services, notamment pour des populations vulnérables. Les technologies d’assistance, les outils de diagnostic à distance ou encore l’automatisation de certaines tâches contribuent à renforcer l’inclusion et la sécurité. Dans le même temps, ces transformations redéfinissent les équilibres du travail, en automatisant des fonctions entières et en déplaçant les compétences attendues. L’enjeu n’est donc pas uniquement technologique, mais profondément socio-économique.

Du point de vue de la gouvernance, l’IA ouvre également de nouvelles perspectives. Elle permet de traiter des volumes de données auparavant inexploitables, d’identifier des signaux faibles et d’éclairer la prise de décision. Les directions peuvent ainsi mieux anticiper les risques, affiner leurs stratégies et suivre plus finement leurs engagements ESG. Mais cette capacité accrue de pilotage s’accompagne d’une exigence renforcée en matière de transparence et de responsabilité, notamment lorsque les décisions sont partiellement automatisées.

Ce qui émerge, en filigrane, c’est une transformation du rôle même de l’ESG. On passe progressivement d’une logique de conformité et de reporting à une logique de performance durable pilotée par la donnée. L’IA agit ici comme un catalyseur, en rendant possible ce qui était auparavant trop complexe, trop coûteux ou trop lent à mettre en œuvre.

Cependant, cette promesse d’efficacité ne doit pas masquer une réalité plus nuancée. Les mêmes mécanismes qui permettent d’optimiser peuvent aussi amplifier des déséquilibres existants. C’est précisément cette tension — entre potentiel et risque — qui rend nécessaire une lecture ESG structurée de l’intelligence artificielle.

L’angle mort : les risques systémiques de l’IA

Si l’intelligence artificielle ouvre des perspectives significatives pour améliorer la performance ESG, elle introduit simultanément des risques d’une nature et d’une ampleur inédites. Ces risques ne sont pas marginaux : ils sont systémiques, car amplifiés par la vitesse, l’automatisation et l’échelle propre à l’IA.

Sur le plan social et éthique, les dérives potentielles sont déjà documentées. Les biais algorithmiques en sont l’exemple le plus connu. Lorsqu’un modèle est entraîné sur des données historiques biaisées, il reproduit — voire renforce — ces discriminations à grande échelle. Cela peut concerner le recrutement, l’accès au crédit ou encore l’accès à certains services. À cela s’ajoutent des usages plus sensibles, comme les technologies de surveillance ou de reconnaissance faciale, qui posent des questions directes en matière de libertés individuelles et de droits humains.

Au-delà de ces enjeux visibles, l’IA peut également contribuer à des formes plus diffuses de déséquilibres. La désinformation automatisée, les deepfakes ou les systèmes de manipulation algorithmique complexifient le rapport à l’information et fragilisent les dynamiques démocratiques. Dans ce contexte, la responsabilité des organisations ne se limite plus à leurs opérations directes, mais s’étend aux usages indirects de leurs technologies.

Les risques économiques et organisationnels sont tout aussi structurants. L’automatisation massive de certaines tâches transforme le marché du travail, avec des effets potentiellement asymétriques selon les secteurs et les niveaux de qualification. Les emplois les plus exposés sont souvent les plus précaires, ce qui pose une question de justice sociale. Par ailleurs, la dépendance croissante à des technologies complexes, souvent développées par un nombre limité d’acteurs, crée de nouvelles formes de vulnérabilité stratégique.

L’opacité des modèles constitue un autre point critique. De nombreux systèmes d’IA, notamment les plus performants, fonctionnent comme des “boîtes noires”, rendant difficile la compréhension de leurs décisions. Cette absence de transparence entre en tension directe avec les exigences de gouvernance ESG, qui reposent sur la traçabilité, l’auditabilité et la responsabilité.

Enfin, l’impact environnemental de l’IA reste encore largement sous-estimé. L’entraînement et l’utilisation de certains modèles, en particulier dans le domaine de l’IA générative, nécessitent des ressources considérables : énergie, eau, infrastructures matérielles. À cela s’ajoute la question des déchets électroniques et des chaînes d’approvisionnement liées aux équipements numériques. L’IA, souvent présentée comme un outil au service de la transition écologique, devient ainsi elle-même un facteur d’impact environnemental à intégrer pleinement dans les stratégies ESG.

Ce qui rend ces risques particulièrement complexes, c’est leur caractère diffus et interconnecté. Ils ne relèvent pas d’un seul département ou d’une seule fonction, mais traversent l’ensemble de l’organisation. En ce sens, ils ne peuvent être traités uniquement par des approches techniques ou juridiques. Ils nécessitent une lecture globale, structurée — précisément celle que propose l’ESG.

Ignorer ces enjeux reviendrait à reproduire les erreurs déjà observées avec d’autres technologies : adopter rapidement, puis réguler tardivement. Dans le cas de l’IA, ce décalage pourrait s’avérer plus coûteux, tant les effets d’échelle sont importants.

IA responsable : un prolongement naturel de l’ESG

Face à cette montée en complexité, la notion d’“IA responsable” s’impose progressivement comme un cadre structurant. Elle ne constitue pas une rupture avec les démarches ESG existantes, mais plutôt leur extension logique dans un environnement technologique.

L’IA responsable repose sur une idée simple en apparence : concevoir et utiliser des systèmes d’intelligence artificielle de manière à maximiser leurs bénéfices tout en limitant leurs impacts négatifs. En pratique, cette ambition implique une transformation plus profonde des modes de conception, de déploiement et de pilotage des technologies.

Les grands principes de l’IA responsable — équité, transparence, sécurité, responsabilité, respect de la vie privée — font directement écho aux piliers de l’ESG. L’équité renvoie aux enjeux sociaux de non-discrimination et d’inclusion. La transparence et l’explicabilité s’inscrivent dans les exigences de gouvernance. La prise en compte des impacts environnementaux des systèmes d’IA prolonge naturellement les objectifs climatiques et de durabilité.

Cette convergence n’est pas théorique. Elle traduit une réalité opérationnelle : les organisations disposent déjà, à travers leurs démarches ESG, de nombreux outils et réflexes utiles pour encadrer l’IA. Les approches de gestion des risques, les politiques de conformité, les dispositifs de reporting ou encore les mécanismes d’audit peuvent être adaptés pour intégrer les spécificités des systèmes intelligents.

Cependant, une nuance importante mérite d’être soulignée. L’IA responsable ne peut pas se limiter à une transposition des cadres existants. Les caractéristiques propres à l’IA — notamment son opacité, sa capacité d’apprentissage et son autonomie partielle — nécessitent des ajustements. Par exemple, la notion de responsabilité devient plus complexe lorsque les décisions sont prises par des systèmes probabilistes. De même, la transparence ne se limite plus à la publication d’informations, mais suppose une capacité réelle à expliquer des résultats parfois difficiles à interpréter.

On observe également un risque émergent : celui du “ethics washing”. Certaines organisations affichent des principes d’IA responsable sans les traduire concrètement dans leurs pratiques. Cette dissociation entre discours et réalité fragilise la confiance et souligne l’importance de mécanismes vérifiables, mesurables et auditables.

Dans ce contexte, l’ESG joue un rôle clé. Il offre une structure permettant de passer de l’intention à l’action, en intégrant l’IA dans des processus existants de gouvernance et de performance. L’enjeu n’est donc pas d’ajouter une couche supplémentaire de complexité, mais d’articuler intelligemment ces deux cadres.

Cette articulation marque une évolution importante : l’ESG ne se limite plus à encadrer les activités de l’entreprise, il s’étend désormais à ses systèmes technologiques. L’IA devient ainsi un nouvel objet de gouvernance, au même titre que les chaînes d’approvisionnement ou les impacts environnementaux.

La question n’est plus de savoir s’il faut encadrer l’IA, mais comment le faire de manière cohérente, crédible et efficace.

La transformation des chaînes de valeur : vers une “supply chain de l’IA”

L’un des angles les plus sous-estimés de l’intégration de l’intelligence artificielle dans les organisations concerne la transformation des chaînes de valeur. Contrairement à une vision simplifiée où l’IA serait un simple outil interne, elle repose en réalité sur un écosystème complexe, fragmenté et souvent opaque.

Un système d’IA ne se limite pas à un algorithme. Il dépend d’une chaîne d’approvisionnement composée de multiples briques : sources de données, infrastructures cloud, modèles pré-entraînés, fournisseurs technologiques, APIs, outils de déploiement. Cette chaîne est rarement maîtrisée de bout en bout par une seule organisation. Elle est distribuée, interconnectée et en constante évolution.

Cette complexité pose une question centrale :

qui est responsable, et de quoi ?

Par exemple, lorsqu’un modèle produit un résultat biaisé ou erroné, la responsabilité peut être diffuse :

- provient-elle des données utilisées ?

- du modèle lui-même ?

- de son paramétrage ?

- ou de son intégration dans un processus métier ?

Cette dilution de la responsabilité contraste fortement avec les exigences ESG, qui reposent sur des principes de traçabilité, de transparence et d’accountability. Elle crée un décalage entre la réalité technologique et les attentes réglementaires et sociétales.

Ce phénomène n’est pas sans précédent. Il rappelle les enjeux déjà rencontrés dans d’autres chaînes d’approvisionnement complexes, notamment celles liées aux matières premières, à la déforestation ou au travail forcé. Dans ces contextes, les entreprises ont progressivement mis en place des mécanismes de traçabilité, d’audit et de certification pour mieux contrôler leurs impacts.

L’IA suit une trajectoire similaire.

On voit émerger la notion de “supply chain de l’IA”, avec des enjeux comparables :

- traçabilité des données utilisées

- transparence sur les modèles et leurs limites

- évaluation des fournisseurs technologiques

- capacité à auditer les systèmes

Cette évolution implique un changement de posture. Il ne suffit plus d’évaluer les impacts directs d’une organisation, mais également ceux liés aux technologies qu’elle utilise. L’IA devient ainsi un vecteur indirect d’impact ESG, au même titre que les fournisseurs ou les partenaires.

Dans ce contexte, de nouvelles pratiques vont progressivement s’imposer. Les entreprises devront être capables de documenter leurs systèmes d’IA, d’identifier les risques associés à chaque composant et de démontrer leur conformité à des standards émergents. Cela suppose des outils, des méthodologies et des compétences spécifiques, encore en construction.

Cette transformation ouvre également un espace d’innovation. À mesure que les exigences de transparence et de responsabilité augmentent, des solutions dédiées à la gouvernance de l’IA — traçabilité, certification, mesure d’impact — deviennent nécessaires. Elles pourraient, à terme, jouer un rôle similaire à celui des outils de reporting ESG actuels, mais appliqués aux systèmes intelligents.

L’enjeu dépasse donc la seule maîtrise technologique. Il s’agit de structurer une nouvelle forme de gouvernance, adaptée à des chaînes de valeur numériques, complexes et globalisées.

Gouvernance et régulation : vers un nouveau standard

À mesure que l’intelligence artificielle s’intègre dans les processus critiques des organisations, la question de sa gouvernance ne peut plus être traitée de manière marginale. Elle devient un enjeu structurant, au croisement des obligations réglementaires, des attentes des parties prenantes et des impératifs de gestion des risques.

Contrairement à d’autres technologies, l’IA n’évolue pas dans un vide juridique. Elle s’inscrit déjà dans un cadre réglementaire dense : protection des données, cybersécurité, non-discrimination, droit du travail, responsabilité produit. Toutefois, ces cadres existants montrent rapidement leurs limites face à des systèmes capables d’apprendre, d’évoluer et de produire des décisions difficilement explicables.

C’est dans ce contexte que de nouvelles régulations spécifiques émergent, notamment en Europe avec des dispositifs dédiés à l’intelligence artificielle. L’objectif est clair : encadrer les usages à risque, imposer des exigences de transparence et renforcer les mécanismes de responsabilité. Parallèlement, des standards internationaux commencent à structurer les pratiques, en proposant des cadres de management adaptés aux systèmes d’IA.

Mais au-delà des obligations formelles, c’est surtout la pression des parties prenantes qui accélère cette transformation. Investisseurs, clients, collaborateurs et régulateurs attendent désormais des organisations qu’elles soient capables d’expliquer comment leurs systèmes d’IA fonctionnent, quels impacts ils génèrent et quelles mesures sont mises en place pour en maîtriser les risques.

Cette exigence marque une évolution importante du rôle de la gouvernance. Il ne s’agit plus seulement de superviser des activités humaines, mais aussi des systèmes automatisés. Cela suppose de nouvelles compétences, de nouveaux processus et, surtout, une capacité à articuler expertise technique et vision stratégique.

Dans ce contexte, plusieurs axes deviennent structurants. La mise en place de politiques internes dédiées à l’IA constitue souvent une première étape, en formalisant des principes et des règles d’usage. Mais ces politiques ne suffisent pas. Elles doivent être accompagnées de dispositifs concrets : comités de gouvernance, procédures d’audit, mécanismes de contrôle, indicateurs de suivi.

La question du reporting est également appelée à évoluer. Si les entreprises ont progressivement structuré leurs disclosures ESG, les informations relatives à l’IA restent encore limitées et peu standardisées. Cette situation devrait évoluer rapidement, sous l’effet combiné des régulations et des attentes du marché. À terme, la transparence sur les systèmes d’IA pourrait devenir un élément central du reporting extra-financier.

Ce mouvement traduit une tendance de fond :

l’IA est en train de devenir un objet de gouvernance à part entière.

Elle ne peut plus être laissée à la seule responsabilité des équipes techniques. Elle nécessite une approche transversale, impliquant la direction, les fonctions risques, conformité, ESG et innovation.

Pour les organisations, l’enjeu est double. Il s’agit, d’une part, de se conformer à des exigences croissantes, et, d’autre part, de transformer cette contrainte en opportunité. Celles qui parviendront à structurer une gouvernance claire, crédible et proactive de leurs systèmes d’IA pourront non seulement limiter leurs risques, mais aussi renforcer leur positionnement sur un marché de plus en plus sensible à ces enjeux.

De la conformité à l’avantage compétitif

À ce stade, une bascule s’opère. L’IA responsable et sa gouvernance ne relèvent plus uniquement d’une logique de conformité ou de gestion des risques. Elles deviennent progressivement un levier de différenciation stratégique.

Le premier facteur clé est la confiance. Dans un contexte où la perception de l’intelligence artificielle reste fragile — marquée par des inquiétudes sur les biais, la transparence ou l’usage des données — les organisations capables de démontrer un usage maîtrisé et responsable de l’IA disposent d’un avantage réel. Cette confiance ne se décrète pas. Elle se construit à travers des preuves : des pratiques documentées, des systèmes auditables, des engagements tenus dans la durée.

Pour les investisseurs, cette capacité devient un signal fort. Une entreprise capable d’intégrer l’IA dans une démarche ESG structurée envoie un message clair sur sa maturité : elle anticipe les risques, comprend ses impacts et se positionne dans une logique de long terme. À l’inverse, une adoption opportuniste et peu encadrée peut être perçue comme un facteur d’incertitude supplémentaire.

Du côté des clients et des utilisateurs, les attentes évoluent également. La performance technique ne suffit plus. Les questions émergent : comment mes données sont-elles utilisées ? les décisions sont-elles explicables ? existe-t-il un recours en cas d’erreur ? Ces interrogations traduisent une montée en exigence qui redéfinit les critères de choix.

En interne, la gouvernance de l’IA joue aussi un rôle structurant. Elle permet d’aligner les équipes, de clarifier les responsabilités et de sécuriser les déploiements. Dans des organisations où les usages de l’IA se multiplient rapidement, cette structuration devient un facteur d’efficacité opérationnelle autant que de maîtrise des risques.

On observe ainsi une évolution du positionnement de l’IA responsable. Initialement perçue comme une contrainte — un cadre à respecter — elle tend à devenir un actif stratégique. Les entreprises les plus avancées ne cherchent pas seulement à “faire correctement”, elles utilisent ces exigences pour renforcer leur crédibilité, structurer leur offre et se différencier sur leur marché.

Cette dynamique reste toutefois inégale. Beaucoup d’organisations en sont encore à un stade exploratoire, avec des initiatives dispersées et peu coordonnées. Le risque, dans ce cas, est double : sous-estimer les impacts réels de l’IA tout en passant à côté des opportunités qu’elle offre.

À l’inverse, celles qui parviennent à intégrer pleinement ces enjeux — en articulant technologie, ESG et gouvernance — se positionnent en précurseurs. Elles contribuent, de fait, à définir les standards qui structureront le marché dans les années à venir.

L’IA responsable cesse alors d’être un sujet périphérique. Elle devient un marqueur de maturité et un levier de création de valeur.

Vers une nouvelle génération d’outils et de standards

Si l’on suit la logique développée jusqu’ici, une conclusion s’impose : les cadres actuels ne suffisent pas à opérer efficacement l’IA responsable. Les principes existent, les intentions sont largement partagées, mais les outils concrets permettant de les appliquer restent encore fragmentés.

Aujourd’hui, la plupart des organisations avancent avec des approches hybrides : politiques internes, comités éthiques, audits ponctuels. Ces dispositifs ont le mérite d’exister, mais ils peinent à suivre le rythme et la complexité des déploiements réels de l’IA. Ils sont souvent déclaratifs, peu intégrés aux opérations, et difficiles à industrialiser.

Or, à mesure que l’IA devient un actif stratégique, les attentes évoluent. Il ne s’agit plus seulement de définir des principes, mais de pouvoir démontrer, mesurer et piloter les impacts de manière continue. Cela implique l’émergence d’une nouvelle génération d’outils, à l’interface entre technologie, gouvernance et ESG.

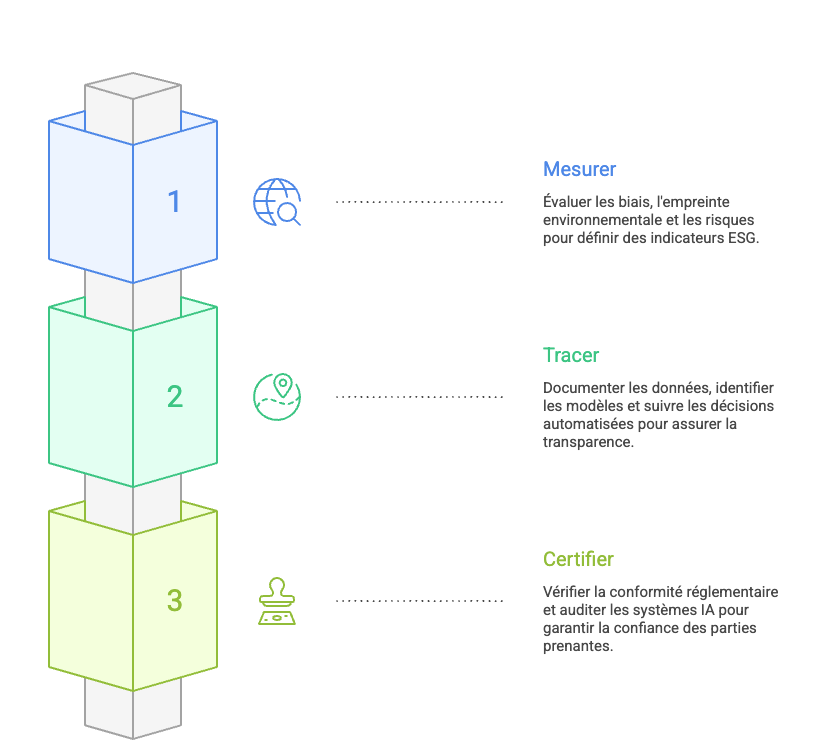

Trois besoins structurants se dessinent.

Le premier est celui de la mesure. Les organisations doivent être capables d’évaluer l’impact réel de leurs systèmes d’IA, qu’il s’agisse de biais, de performance sociale ou d’empreinte environnementale. Cette capacité de mesure est encore embryonnaire. Elle nécessite des indicateurs adaptés, des méthodologies robustes et des données fiables.

Le deuxième est celui de la traçabilité. Dans un environnement où les systèmes d’IA reposent sur des chaînes de valeur complexes, il devient essentiel de documenter les modèles, les տվյալ datasets, les choix de conception et les conditions d’utilisation. Cette traçabilité conditionne la capacité à auditer, à expliquer et à corriger.

Le troisième est celui de la certification. À mesure que les régulations se renforcent, les organisations devront démontrer leur conformité à des standards précis. Cela ouvre la voie à des mécanismes de labellisation ou de scoring des systèmes d’IA, comparables à ce qui existe déjà dans d’autres domaines ESG.

Ces trois dimensions — mesurer, tracer, certifier — constituent les briques d’une gouvernance opérationnelle de l’IA.

Ce mouvement n’en est qu’à ses débuts, mais il est structurant. Il suggère que l’IA responsable ne pourra pas reposer uniquement sur des engagements volontaires. Elle nécessitera des infrastructures, des outils et des standards partagés, capables de rendre les pratiques comparables et vérifiables.

Dans ce contexte, un espace d’innovation s’ouvre. Les organisations qui sauront développer ou adopter ces solutions pourront non seulement répondre aux exigences réglementaires, mais aussi structurer leur avantage compétitif. À terme, la capacité à piloter l’impact des systèmes d’IA pourrait devenir aussi déterminante que la capacité à piloter les émissions carbone aujourd’hui.

L’enjeu n’est donc plus seulement d’utiliser l’IA, mais de construire les conditions de sa maîtrise.

L’IA redéfinit le rôle de l’ESG

L’intégration de l’intelligence artificielle dans les organisations ne constitue pas une évolution marginale. Elle marque un changement de paradigme. Là où l’ESG s’est historiquement structuré autour des impacts des activités économiques, il doit désormais intégrer une nouvelle couche : celle des systèmes technologiques qui pilotent, influencent et parfois automatisent ces activités.

Ce déplacement est majeur. Il transforme l’ESG en profondeur, en le rendant plus technique, plus dynamique et plus directement connecté aux opérations. L’enjeu n’est plus uniquement de mesurer des impacts passés, mais de comprendre et de maîtriser des systèmes en temps réel, capables d’amplifier des effets positifs comme négatifs.

Dans ce contexte, les frontières traditionnelles s’estompent. Les sujets ESG ne peuvent plus être traités indépendamment des équipes data, IT ou innovation. Inversement, les décisions technologiques ne peuvent plus être prises sans une lecture de leurs implications environnementales, sociales et de gouvernance. Cette convergence impose une approche plus intégrée, plus transversale.

Elle impose aussi une montée en maturité. Comprendre l’IA ne suffit plus. Il faut être capable de la gouverner, de l’auditer, de la challenger. Cela suppose de nouveaux outils, de nouvelles compétences, mais aussi une évolution des cultures organisationnelles.

Ce mouvement reste encore en construction. Beaucoup d’organisations en sont à un stade exploratoire, avec des initiatives dispersées et des cadres encore flous. Mais la trajectoire est claire. À mesure que l’IA s’impose comme une infrastructure clé, les exigences de transparence, de responsabilité et de performance vont s’intensifier.

Dans ce paysage, une ligne de fracture se dessine. D’un côté, des organisations qui abordent l’IA comme un simple levier d’efficacité, au risque d’en subir les effets secondaires. De l’autre, celles qui l’intègrent dans une logique de gouvernance, en cohérence avec leurs engagements ESG.

Ce sont ces dernières qui définiront les standards.

Car au fond, la question n’est plus technologique. Elle est stratégique :

comment utiliser l’intelligence artificielle sans perdre le contrôle de ses impacts ?

La réponse ne viendra ni uniquement de la régulation, ni uniquement de l’innovation. Elle émergera de leur articulation et de la capacité des organisations à structurer cette interface.

L’ESG, dans cette perspective, n’est pas un frein. Il devient un cadre d’action. Un cadre pour orienter, sécuriser et, surtout, donner du sens à l’usage de technologies qui redéfinissent déjà les règles du jeu.